AI와 알고리즘 편향성

기술이 만든 보이지 않는 차별, 그 시작점

AI는 데이터를 바탕으로 판단을 내립니다

그러나 그 알고리즘은 인간이 설계하고, 인간의 세계관을 반영합니다

"객관적이라 믿었던 기술이 어느새 차별을 만들고 있었습니다"

특히 성별, 인종, 지역 등 민감한 요소가 데이터에 섞이면

AI는 이를 그대로 반영하면서 '보이지 않는 차별'을 고착화할 수 있습니다

데이터의 덫

AI가 편견을 학습하고 재생산하는 구조

AI는 과거 데이터를 기반으로 학습합니다

그렇기에 과거에 존재했던 편견과 왜곡된 시선이 그대로 이어집니다

예를 들어, 남성이 많았던 직업군의 데이터를 학습한 AI는

여성 지원자를 낮게 평가하는 알고리즘을 만들 수 있습니다

"AI는 공정하지 않은 세상을 그대로 학습합니다"

이 점이 데이터 기반 알고리즘의 핵심 위험 요소입니다.

사회적 신뢰를 위협하는 AI

알고리즘은 누구를 위해 작동하는가?

금융, 복지, 교육 등 민감한 분야에서

AI의 결정이 사람들의 삶에 지대한 영향을 미칩니다

하지만 그 결정 기준은 종종 불투명하며

이로 인해 신뢰는 점점 약해지고 있습니다

공정성을 확보하려면

AI가 어떤 기준으로 판단을 내리는지 명확히 설명할 수 있어야 합니다

"기술은 신뢰를 전제로 존재해야 합니다"

AI 차별의 현실 사례

의료부터 채용까지, 일상에 침투한 불공정

채용 AI가 여성 지원자를 자동 탈락시킨 사건

흑인의 얼굴을 제대로 인식하지 못한 공공 감시 시스템

특정 인종에게만 보험료를 높게 책정한 사례

이처럼 AI는 일상에서 실제 차별을 만들어내고 있습니다

"이제는 알고리즘이 차별의 주체가 될 수도 있습니다"

해결을 위한 움직임

책임 있는 AI를 위한 글로벌 흐름

구글, IBM, 마이크로소프트 등은 AI 윤리 가이드라인을 수립했습니다

유럽연합은 AI법(AI Act)을 통해 기술 통제를 법제화하고 있습니다

국내에서도 개인정보 보호법과 AI 윤리기준이 논의되고 있습니다

기술 기업뿐 아니라 국가, 시민사회도

"책임 있는 AI"를 위해 함께 움직이고 있습니다.

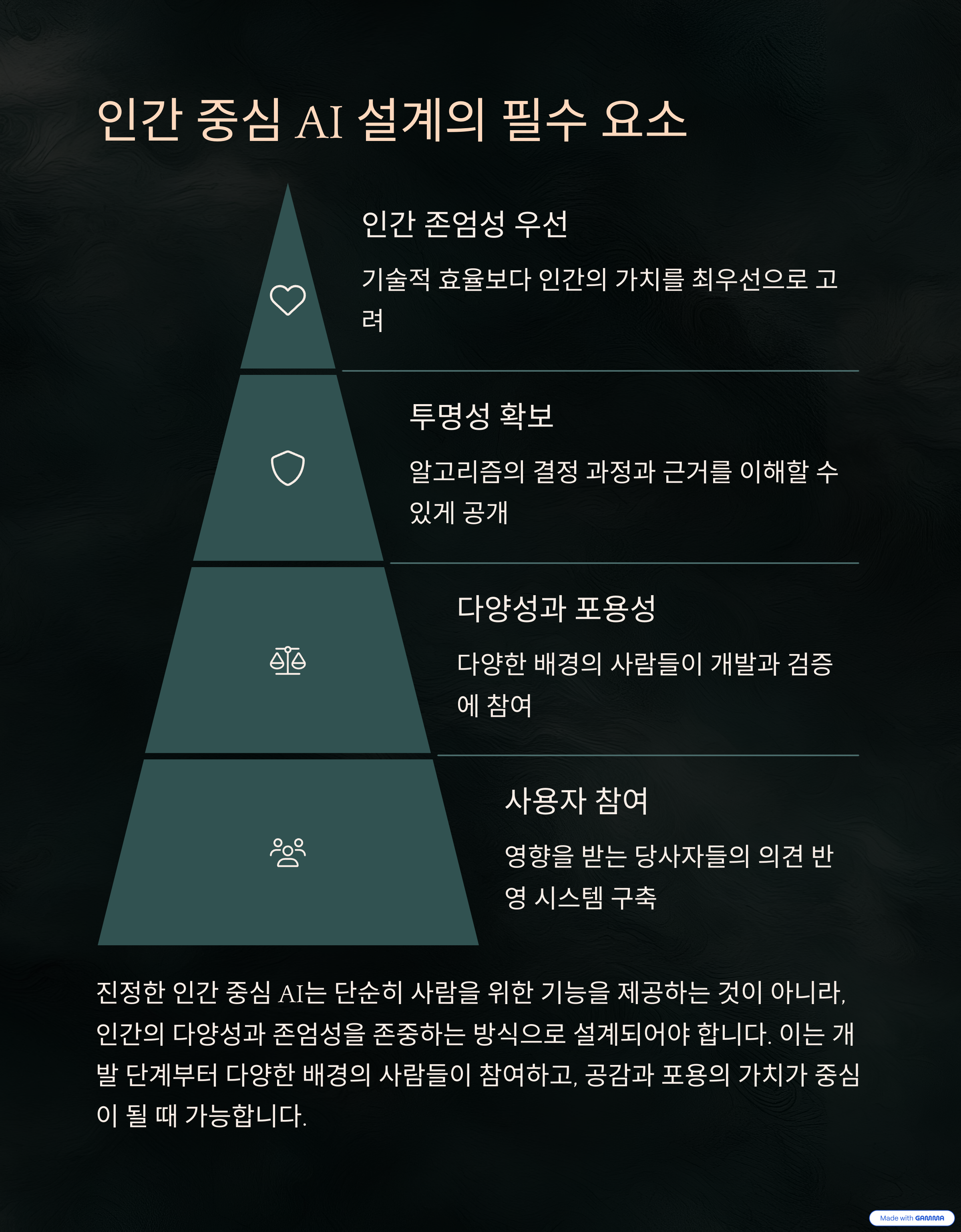

인간 중심 AI를 위한 조건

기술보다 사람이 우선이어야 하는 이유

AI는 도구일 뿐, 목적은 사람입니다

그러나 지금은 기술 효율만 강조되고, 사람의 가치가 뒷전이 되곤 합니다

공감, 포용, 다양성 같은 인간적 가치가

기술 설계에 적극 반영되어야 진짜 '사람 중심' AI가 됩니다

"기술보다 인간의 존엄이 우선이어야 합니다"

윤리와 법의 균형

AI 규제를 위한 제도적 기반은 충분한가?

아직 많은 국가에서 AI 관련 법제화는 초보적 수준입니다

윤리 가이드라인은 있지만 강제력이 없고, 법은 기술을 따라가지 못합니다

책임소재가 불분명하고, 알고리즘 투명성도 부족한 상황에서

AI를 제어할 제도는 여전히 미흡합니다

"기술 발전보다 더 중요한 건, 그에 맞는 법과 윤리의 진화입니다"